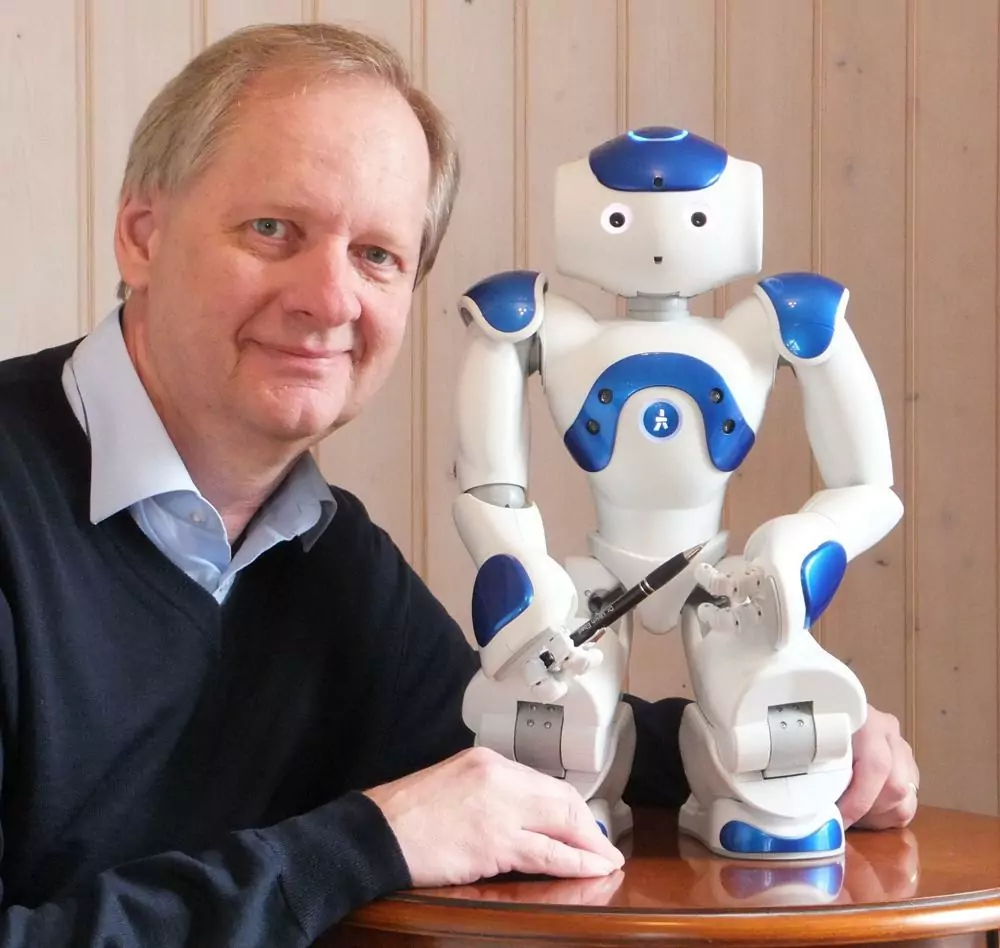

Ein Blick in unsere Umgebung genügt: Künstliche Intelligenz ist längst im Alltag der Menschen angekommen. Meist in unverfänglichen Formen, als Staubsaugerroboter beispielsweise. Die Branche ist im Kommen und bietet damit immer mehr Arbeitsplätze für Hochschulabsolvent:innen. Doch diese Technologie wird nicht nur alle Lebensbereiche des Menschen massiv verändern, sondern sie lässt sich auch – einmal entwickelt – ,zweckentfremdet’ einsetzen. hitech-campus.de sprach mit Ulrich Eberl über die aktuellen Herausforderungen der Künstlichen Intelligenz (KI).

Herr Eberl, das Fachgebiet der Robotik ist zweigeteilt: Die Mechanik und die Informationstechnik, mit der das Gerät läuft. Welche ist die aktuell größte Herausforderung?

Sicherlich die Informationstechnik, denn elektromechanisch sind Maschinen heute schon sehr weit. Es gibt Roboter, die schneller laufen als Usain Bolt, der Weltmeister. Andere können klettern und Dinge greifen – sogar so sanft, dass sie beim Pflücken von Erdbeeren keine Druckspuren hinterlassen. Eine besondere Herausforderung ist noch die Soft Robotics, also die Herstellung weicher und flexibel steuerbarer, beweglicher Strukturen. Aber spannender finde ich, was im Gehirn smarter Maschinen derzeit passiert.

An was denken Sie dabei?

Dass die Maschinen der Zukunft nicht mehr klassisch programmiert, sondern selbst aktiv werden. Ich spreche in meinem Buch ,Smarte Maschinen’ auch ganz bewusst nicht nur von klassischen Robotern, sondern von allen Maschinen, die über eine gewisse Intelligenz verfügen. Das heißt, dass sie sprechen und zuhören, Gestik und Mimik verstehen, Texte, Bilder und Videos interpretieren und lernfähig sind: durch Beobachten, Vergleichen, Nachahmen oder Belohnungen. Wir werden diese smarten Maschinen brauchen: als Hilfen für die älter werdende Bevölkerung ebenso wie für nachhaltige Energiesysteme und eine wettbewerbsfähige Industrie. Wir werden in einer Gemeinschaft von Menschen und smarten Maschinen aller Art leben.

Zukünftig lebt der Mensch mit smarten Maschinen zusammen

Nehmen wir ein aktuelles Praxisbeispiel: die selbstfahrenden Autos – wie viel Robotik steckt wirklich drin?

Schon im Jahr 2013 fuhr ein Mercedes völlig selbstständig von Mannheim nach Pforzheim. Eine Strecke von etwa 100 Kilometern – und zwar nicht auf der Autobahn, sondern über Landstraßen und im Stadtverkehr mit Ampeln, querenden Fahrzeugen, Fußgängern und Fahrrädern. Er brauchte dazu keine teuren Laserscanner wie die von Google bekannten Fahrzeuge, sondern schaffte es mit verschiedenen Kameras und Radarsensoren, die zum Teil sowieso schon verbaut sind. Machbar ist es, aber natürlich noch nicht serientauglich. Die Herausforderung liegt in der richtigen Software, mit der das autonome Fahrzeug Szenen einschätzen muss. Etwa ob ein Fußgänger gleich die Straße überqueren will. Auf Autobahnen mit ihrer klaren Struktur wird man, so sagen die Forscher, bereits ab 2020 in den Automatikmodus schalten können, in komplexeren Umgebungen wird dies noch zehn Jahre länger dauern.

Wenn die Robotik schon so weit ist, warum sehen wir so wenig davon im Alltag?

Vielleicht muss man nur etwas genauer hinschauen, weil nicht alle smarten Maschinen sofort als solche erkennbar sind. Die Smartphones und elektronischen Assistenten à la Siri, Cortana und Google Now zählen ja ebenso dazu wie die Roboter, die in Fabriken werkeln. Hinzu kommen die Staubsaug-, Rasenmäh- und Fensterputzroboter in den Haushalten oder auch die Mäh- und Ernteroboter in der Landwirtschaft, die Drohnen in der Luft und die Logistikroboter in den Warenlagern: Insgesamt gibt es weltweit wohl zwischen 20 und 30 Millionen Service- und Industrieroboter. Tendenz stark steigend.

Mehr Beiträge zum Thema Künstliche Intelligenz findest du hier.

Legen sich Entwickler, die Roboter vor allem am Vorbild Mensch ausrichten wollen, nicht selbst Steine in den Weg, weil sie ihre eigene Vorstellungskraft beschneiden?

Allein schon die Tatsache, dass es im Jahr 2050 weltweit eine Milliarde Senioren mehr geben wird als heute und dass viele davon zwischen 80 und 100 Jahre alt sein werden, legt nahe, dass wir smarte Maschinen brauchen werden. Wir werden mit ihnen richtige Gespräche führen wollen. Sie werden Gestik, Mimik und Emotionen korrekt deuten können und sie werden natürlich in unserem Alltag mit all seinen Türen, Tischen und Treppen zurechtkommen müssen. Dafür brauchen sie Beine, Hände und zumindest eine Art Gesicht für eine emotionale Ansprache und Reaktion. Je intuitiver wir mit ihnen umgehen können, umso besser: Für humanoide Roboter brauchen wir keine Bedienungsanleitung. Abgesehen davon gibt es natürlich eine Menge anderer Forschungsarbeiten: von Maschinen, die Elefantenrüssel besitzen oder Greifer wie Chamäleonzungen bis hin zu den vollkommen flexiblen Strukturen eines künstlichen Oktopus.

Mit Deep Learning wird Künstliche Intelligenz besser lernen als Menschen

Ein Konzept, mit dem Roboter selbstständiger werden sollen, wird als Deep Learning bezeichnet. Könnten Sie es unseren Lesern bitte kurz zusammenfassen?

Deep Learning ist eine Weiterentwicklung der Neuronalen Netze aus den 1980er-Jahren, die sich an der Funktionsweise der Nervenzellen im Gehirn, der Neuronen, orientieren. Die künstlichen sind dabei in mehreren Schichten angeordnet und zwar meist so, dass jedes Neuron der einen Schicht mit allen anderen der nächsten verbunden ist. Wird eines aktiv, reicht es das Signal an alle nachfolgenden Neuronen weiter. Dabei kann das Gewicht jeder Verbindung infolge von Lernprozessen stärker oder schwächer eingestellt werden. Wie im Gehirn feuert ein Neuron nur dann, wenn die Summe der bei ihm eingehenden Signale einen bestimmten Schwellenwert überschreitet. Gelernt wird in derartigen Netzen durch Rückkopplung: Werden der ersten Schicht beispielsweise Bilder von Häusern vorgelegt, sollte das Ergebnis der letzten Schicht ,Haus’ lauten. Während des Lernens werden die Gewichte der neuronalen Verbindungen mathematisch so modifiziert, dass das Ergebnis immer besser zum gewünschten Resultat passt. Dabei erkennen die Schichten jeweils unterschiedliche Muster – die untersten also etwa Ecken und Kanten, schräge Linien und Kreise. Höhere Schichten finden dann schon komplexere Strukturen wie Türen, Dächer und Fenster.

Welche Firmen sind Vorreiter bei dem Thema?

Bei Deep-Learning-Verfahren sind es Firmen wie Google und Facebook, aber auch Uni-Ausgründungen wie etwa Affectiva für die Emotionserkennung. In Sachen maschineller Wissensverarbeitung ist IBM mit seinem Watson-System ganz weit vorne. Hinsichtlich autonomer Fahrzeuge spielen neben Google alle Fahrzeughersteller – vor allem die deutschen – eine entscheidende Rolle. In der industriellen Robotik sind es Firmen wie Fanuc und Yaskawa, ABB und Kuka, aber auch Amazon für die Warenlogistik. Und dann gibt es noch die industrielle Datenanalyse, wo sich die Großen wie Siemens, Bosch und General Electric tummeln. Bisher hat aber noch niemand all diese Entwicklungsstränge zusammengeführt, so dass er zum Weltmarktführer der smarten Maschinen aufsteigen könnte.

An sich wurde der Begriff ,Robotik’ von Isaac Asimov, einem SciFi-Autor, erfunden. Der diskutierte schon vor Jahrzehnten die Frage der Freiheit für und der Moral von Robotern.

Mit dem Aufkommen der selbstlernenden smarten Maschinen werden wir uns diese Frage stellen müssen. Denn dann lässt sich nicht mehr exakt nachvollziehen, wie und warum die Maschine zu einer bestimmten Antwort oder Entscheidung gekommen ist. So sollte der Chatbot Tay im Frühjahr 2016 lernen, wie sich Menschen im Internet unterhalten. Binnen 24 Stunden musste Microsoft ihn wieder vom Netz nehmen, weil er zum Rassisten geworden war, der Hitler lobte. Er hatte offenbar von den falschen Leuten gelernt. Wie bei lernenden Kindern muss man also genau schauen, auf welche Weise Maschinen lernen und Regeln dafür entwickeln, wie sie Gut und Böse unterscheiden können. Ob und inwieweit sich dann Asimovs berühmte Robotergesetze tatsächlich in Maschinen implementieren lassen, muss sich zeigen. Und ob man smarten Maschinen irgendwann eine eigene Persönlichkeit zugestehen muss, wird noch viel diskutiert werden.

Wie attraktiv ist die Branche für junge Ingenieure und IT-Fachleute?

Wenn man, wie ich es tue, darunter nicht nur die klassische Robotik versteht, sondern das gesamte Gebiet der Künstlichen Intelligenz, dann halte ich es für eine der attraktivsten Zukunftsbranchen überhaupt. Neben den nachhaltigen Energiesystemen und der Bio- und Gesundheitsbranche sind die smarten Maschinen das Feld, in dem die Musik spielt. Insbesondere für IT-Fachleute ist es eine der ganz großen Herausforderungen, das ,Gehirn’ von Maschinen zu entwickeln, die dem Menschen in seiner Intelligenz immer ähnlicher werden. Ich bin allerdings überzeugt davon, dass die Evolution den Menschen mit einem so flexiblen und lernfähigen Gehirn ausgestattet hat, dass wir auch mit ganz neuen Herausforderungen umgehen können. Einschließlich der Herausforderungen, die wir selbst entwickeln – wie die smarten Maschinen.

Stand: Januar 2017